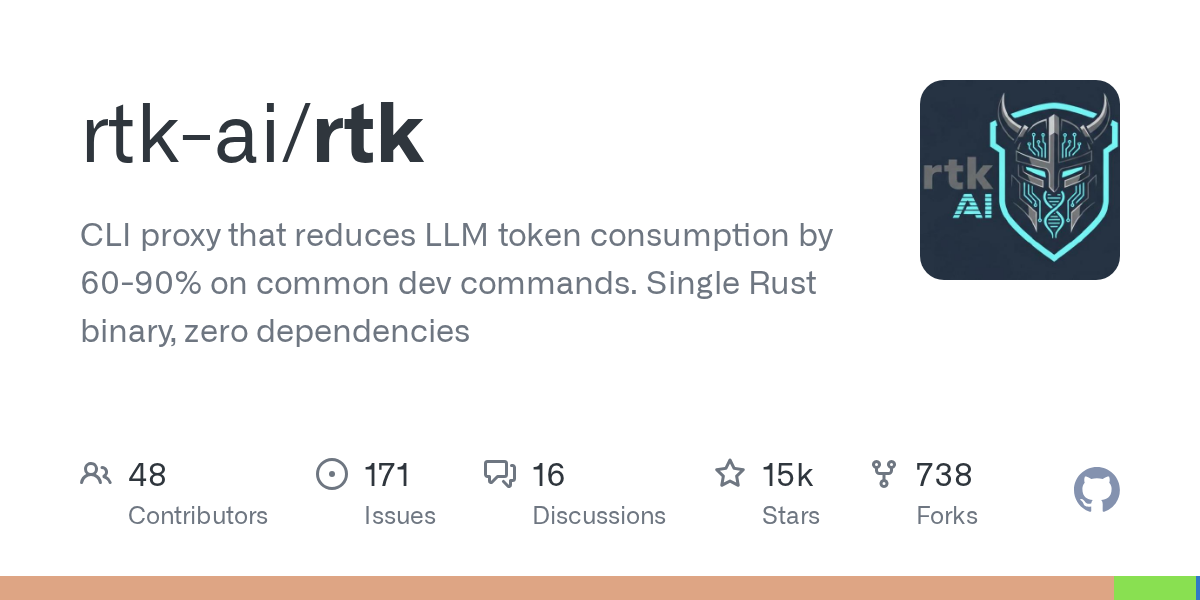

RTK

Nếu team bắt đầu dùng coding agent nghiêm túc, sớm muộn gì bạn cũng đụng tới câu hỏi khó chịu nhất: token đang đội chi phí lên bao nhiêu, và có tối ưu được mà không làm hỏng output không. Đây là loại bài toán ít hấp dẫn hơn chuyện model mới, nhưng tác động rất thực. RTK đáng xem vì nó tiếp cận vấn đề này như một lớp proxy hạ tầng, không buộc bạn phải thay toàn bộ stack đang dùng.

RTK là gì?

RTK là một CLI proxy giúp tối ưu token cho workflow AI coding. Nó nằm giữa công cụ của bạn và model API để lọc và nén context hợp lý hơn, từ đó giảm chi phí cho các vòng lặp phát triển.

Vì sao repo này đáng chú ý?

- Đánh thẳng trực tiếp vào bài toán chi phí khi scale AI coding.

- Triển khai gọn nhẹ bằng Rust binary và dễ test nhanh.

- Hữu ích cho team có tần suất gọi model cao.

Khi nào nên dùng?

Dùng khi bạn cần:

- Cắt token spend mà không đổi toàn bộ stack.

- Quản lý cost theo task coding có tần suất lặp lại.

- Thêm lớp tối ưu cho agent CLI đang hoạt động.

Lưu ý trước khi áp dụng

- Cần benchmark với bộ task đại diện để đánh giá đúng lợi ích.

- Tối ưu quá mức có thể làm mất một phần context quan trọng.

- Nên theo dõi chất lượng output cùng lúc với chi phí.

Khi nào chưa cần dùng?

- Tần suất gọi model của bạn còn thấp nên chi phí chưa thành vấn đề thật.

- Team đang gặp bài toán chất lượng output nhiều hơn bài toán cost.

- Bạn chưa có cách đo token spend và chất lượng theo từng loại task để benchmark.

Phù hợp với ai?

- Team đang scale AI coding và bắt đầu thấy hóa đơn model tăng nhanh.

- Người muốn thêm một lớp tối ưu mà không đổi hẳn công cụ agent đang dùng.

- Nhóm vận hành nhiều workflow lặp lại, nơi mọi phần tiết kiệm token đều có ý nghĩa.

Bắt đầu thực tế như thế nào?

Đừng route toàn bộ traffic qua RTK ngay. Hãy chọn một nhóm task lặp lại như fix bug hoặc refactor, đo token và chất lượng trước-sau trong vài ngày. Nếu savings rõ mà output vẫn giữ ổn định, lúc đó mới đáng mở rộng phạm vi.